首先分析网页结构定位图片链接,再使用requests和BeautifulSoup获取img标签中的src或data-src属性,接着遍历链接批量下载并保存至本地文件夹,最后通过设置请求头、处理相对路径、捕获异常等优化流程,实现高效稳定的图片爬取。

抓取网页图片资源是Python爬虫常见的应用场景之一。通过合理使用请求库和解析工具,可以高效地批量下载目标网页中的图片。关键在于获取图片的URL地址,并将其保存到本地。

1. 分析网页结构,定位图片链接

在开始下载前,先查看网页源码或使用浏览器开发者工具(F12),找到图片标签 <img> 及其 src 属性。注意有些图片可能是懒加载,真实地址藏在 data-src、data-original 等属性中。

常见情况:

- 普通图片:<img src=”https://example.com/photo.jpg”>

- 懒加载图片:<img >

- 背景图CSS样式:需从style中提取 background-image: url(…)

2. 使用requests和BeautifulSoup获取图片链接

安装依赖:

立即学习“Python免费学习笔记(深入)”;

pip install requests beautifulsoup4

示例代码:

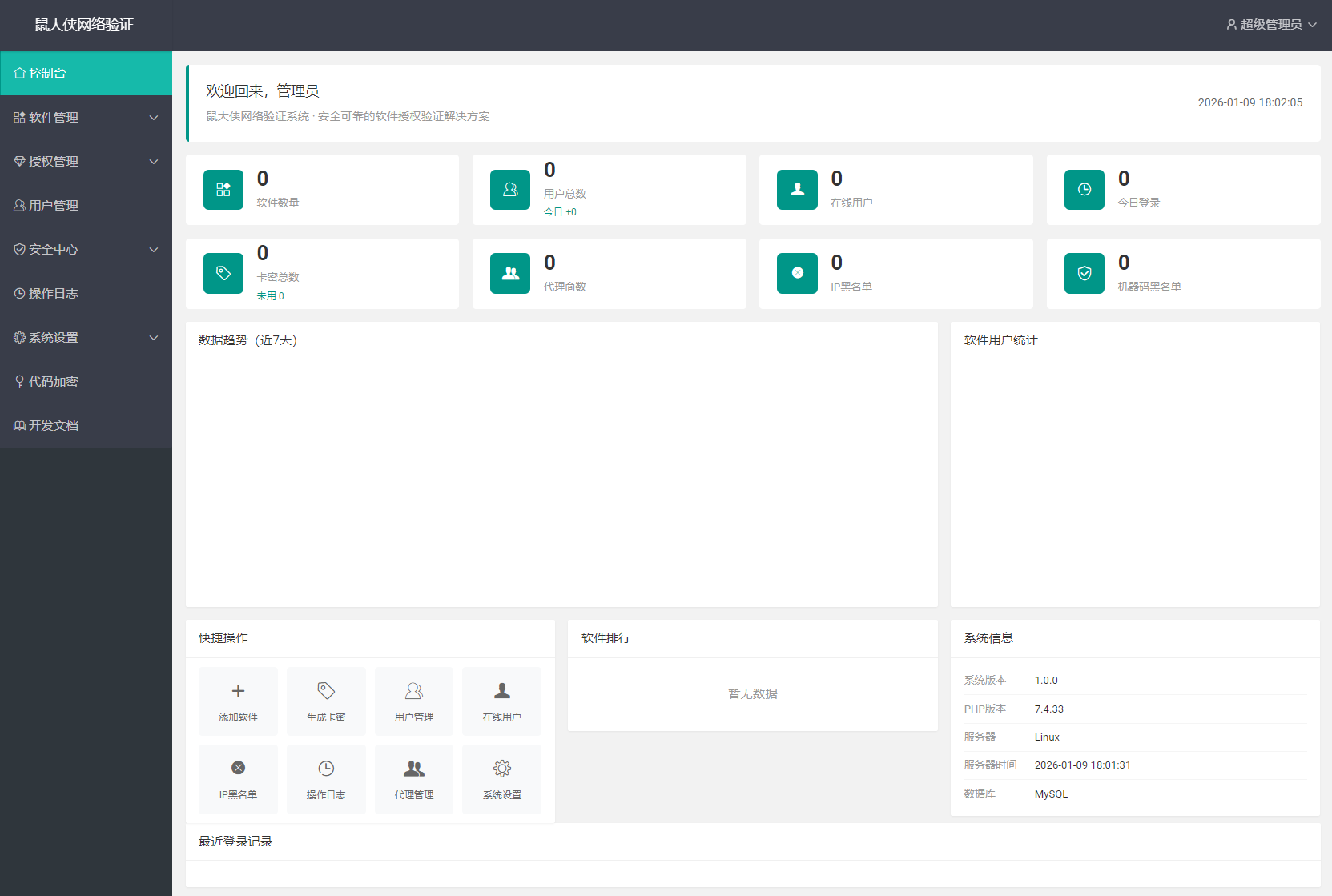

存了个图

17

视频图片解析/字幕/剪辑,视频高清保存/图片源图提取

17

查看详情

import requests

from bs4 import BeautifulSoup

import os

<p>url = "<a href="https://www.php.cn/link/d81b0e461158f9ab6beb7a7cc0872f20">https://www.php.cn/link/d81b0e461158f9ab6beb7a7cc0872f20</a>"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36"

}</p><p>response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')</p><h1>提取所有img标签的图片链接</h1><p>img_tags = soup.find_all('img')

img_urls = []</p><p>for img in img_tags:</p><h1>优先取 data-src,没有则取 src</h1><pre class='brush:python;toolbar:false;'>url = img.get('data-src') or img.get('src')

if url and url.startswith('http'):

img_urls.append(url)

3. 批量下载并保存图片

遍历获取到的图片链接,使用requests下载并写入本地文件。

继续上面的代码:

# 创建保存目录

if not os.path.exists('downloaded_images'):

os.makedirs('downloaded_images')

<h1>下载每张图片</h1><p>for i, img_url in enumerate(img_urls):

try:

img_data = requests.get(img<em>url, headers=headers, timeout=5).content

filename = f"image</em>{i+1}.jpg"

filepath = os.path.join('downloaded_images', filename)</p><pre class='brush:python;toolbar:false;'> with open(filepath, 'wb') as f:

f.write(img_data)

print(f"已下载:{filename}")

except Exception as e:

print(f"下载失败:{img_url}, 错误:{e}")

4. 注意事项与优化建议

实际使用中需注意以下几点以避免问题:

- 设置合理的请求头(User-Agent),防止被反爬识别为机器人

- 添加延迟(time.sleep)控制请求频率,减轻服务器压力

- 处理相对路径:若图片URL是相对路径(如 /uploads/img.jpg),需补全域名

- 过滤非图片格式:检查URL后缀或响应Content-Type

- 异常捕获:网络超时、404错误等要妥善处理

基本上就这些。掌握基础流程后,可扩展支持多线程下载、代理IP、Selenium处理动态加载页面等功能。核心逻辑不变:找链接 → 发请求 → 保存文件。不复杂但容易忽略细节。

相关标签:

python css html windows 浏览器 app 工具 懒加载 Python css beautifulsoup pip 线程 多线程 background https

大家都在看:

如何通过命令行设置Python环境变量_命令行快速配置Python环境变量方法

Python网页版怎样做用户行为日志_Python网页版用户操作日志记录与分析方法

Python入门的网络应用开发_Python入门Socket编程的实践案例

python字符串索引的用法

Windows如何配置Python环境变量_Windows系统配置Python环境变量详细方法

Python网页版怎样做用户行为日志_Python网页版用户操作日志记录与分析方法

Python入门的网络应用开发_Python入门Socket编程的实践案例

python字符串索引的用法

Windows如何配置Python环境变量_Windows系统配置Python环境变量详细方法

本站资料仅供学习交流使用请勿商业运营,严禁从事违法,侵权等任何非法活动,否则后果自负!

THE END

暂无评论内容